Wikipedia se ha convertido en una de las páginas más consultadas de Internet. Bien directamente o de manera indirecta a través de los buscadores, que extraen su información y la organizan para que la leas resumida. Como referente del conocimiento, Wikipedia siempre ha recibido ataques externos en forma de críticas e intentos de vandalismo. Pero sus colaboradores se encargan de que sea lo más fiable y veraz posible. ¿Qué pasaría si esa labor se realizara en una colaboración entre Wikipedia e inteligencia artificial?

Un grupo de investigadores publicaron el pasado mes de octubre un artículo en Nature Machine Intelligence titulado precisamente Improving Wikipedia verifiability with AI. Mejorando la verificabilidad de Wikipedia con IA. Y su texto empieza diciendo: “Mantener y mejorar la calidad de las referencias a Wikipedia es un desafío importante y hay una necesidad apremiante de mejores herramientas para ayudar a los humanos en este esfuerzo”.

Curiosamente, Wikipedia es una de las fuentes principales de las que se nutren muchas inteligencias artificiales para entrenarse y ampliar su base de datos de conocimientos para dar respuestas a los usuarios o para expresarse mejor. Es el caso de la popular GPT. Así que, ¿por qué no combinar Wikipedia e inteligencia artificial para acabar con los errores, inexactitudes y para mejorar la veracidad de sus artículos?

Wikipedia e inteligencia artificial

En el momento de escribir estas líneas, Wikipedia tiene 1,9 millones de artículos en español. Y en inglés, más de 6,7 millones de artículos. Esto se traduce en que esta gran obra del conocimiento humano es una enorme base de datos que cada vez cuesta más de mantener. Cuenta con una gran cantidad de colaboradores, pero también hay muchos intereses creados por parte de países, gobiernos, empresas, marcas y particulares que intentan añadir contenido por intereses personales, comerciales o políticos. Así que garantizar la fiabilidad de Wikipedia es todo un reto.

La investigación antes mencionada sobre el uso de Wikipedia e inteligencia artificial para verificar fuentes de artículos, viene firmada, entre otros, por Fabio Petroni, cofundador de Samaya AI. Se trata de una empresa dedicada a la inteligencia artificial y con sede en Londres. Dejando a un lado que, obviamente, tiene interés en difundir las bondades de la inteligencia artificial, no es menos cierto las conclusiones a las que llega en su análisis.

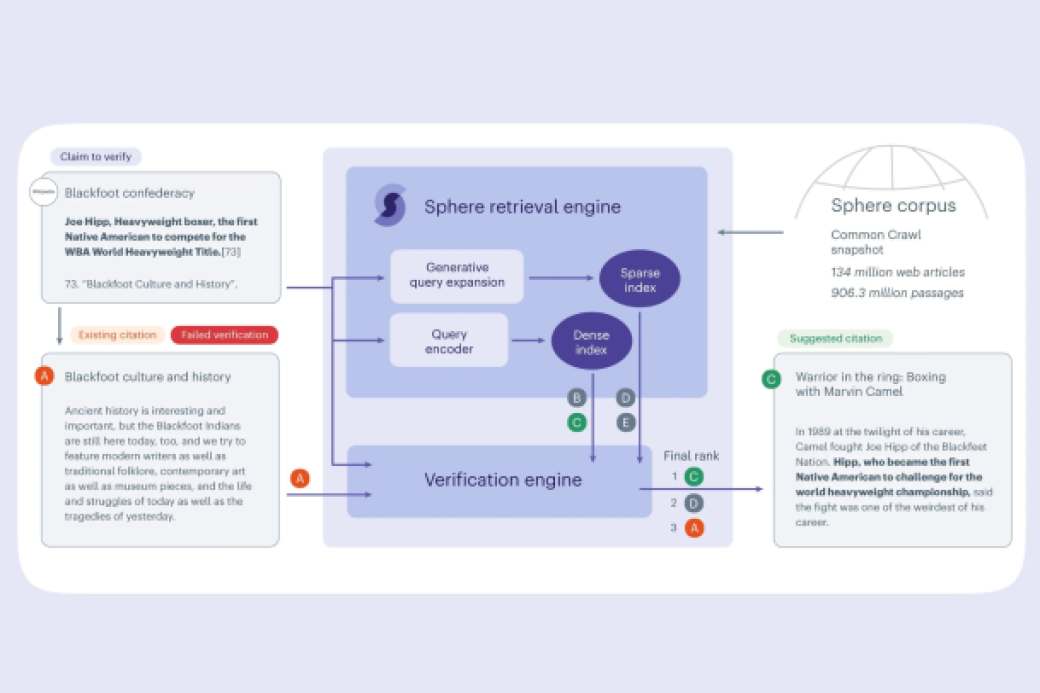

En concreto, dicen haber desarrollado una herramienta llamada SIDE especializada en verificar las citas y referencias que aparecen en Wikipedia. Y para ello emplea inteligencia artificial. La idea es agilizar esta tarea que, en ocasiones, puede resultar algo mecánica. Un trabajo que realizan manualmente miles de colaboradores y voluntarios humanos. SIDE “puede identificar citas de Wikipedia que es poco probable que apoyen sus afirmaciones y, posteriormente, recomendar otras mejores de la web. Entrenamos este modelo en las referencias existentes de Wikipedia”. Es decir, que ayuda a mejorar la Wikipedia. Y, al mismo tiempo, ha sido entrenada con la propia enciclopedia online. “Aprendemos de las contribuciones y la sabiduría combinada de miles de editores de Wikipedia”. Una relación de beneficio mutuo entre Wikipedia e inteligencia artificial.

Trabajo en equipo por el bien de Wikipedia

Las conclusiones de la investigación dicen que “los humanos prefieren las alternativas sugeridas de nuestro sistema en comparación con la referencia citada originalmente en el 70 % de las veces”. Para ello emplearon referencias etiquetadas como no verificables. Es decir, que “se podría utilizar un sistema basado en IA, junto con los humanos, para mejorar la verificabilidad de Wikipedia”. Un trabajo en equipo que no excluya a IA ni a humanos.

Para entrenar la herramienta SIDE utilizaron artículos en inglés. Pero como hemos visto en otros casos de IA, la relación entre Wikipedia e inteligencia artificial podría extenderse a todos los idiomas en los que está disponible esta gran fuente de conocimiento. Solo es cuestión de entrenar la IA con textos en ese idioma para que lo aprenda en mucho menos tiempo que un humano.

Los responsables del estudio explican el funcionamiento de SIDE y de un verificador humano. El editor humano ve la petición de verificación fallida de un artículo o parte del mismo. Hace una búsqueda basada en el contexto de la reclamación y la compara con una consulta en un motor de búsqueda. SIDE aprende a hacer lo mismo pero con un patrón más elaborado a partir de Sphere, una herramienta que facilita la búsqueda de datos en la web. Esta herramienta genera una lista de posibles enlaces o referencias y SIDE decide cuál es más adecuado.

En el futuro, los creadores de SIDE se plantean entrenar esta herramienta para que la relación entre Wikipedia e inteligencia artificial no se limite a textos. Y que también sirva para verificar imágenes y vídeos. También se plantean ir más allá: “Nuestro trabajo asume actualmente que las reclamaciones de Wikipedia son verificables y solo mejora la calidad de las referencias de las reclamaciones existentes. Una extensión natural de nuestro trabajo sería detectar afirmaciones que no son verificables y marcarlas para su revisión por parte de editores humanos”.