El CERN ha alcanzado un récord de información almacenada: más de 200 petabytes de datos, procedentes en su mayoría del LHC.

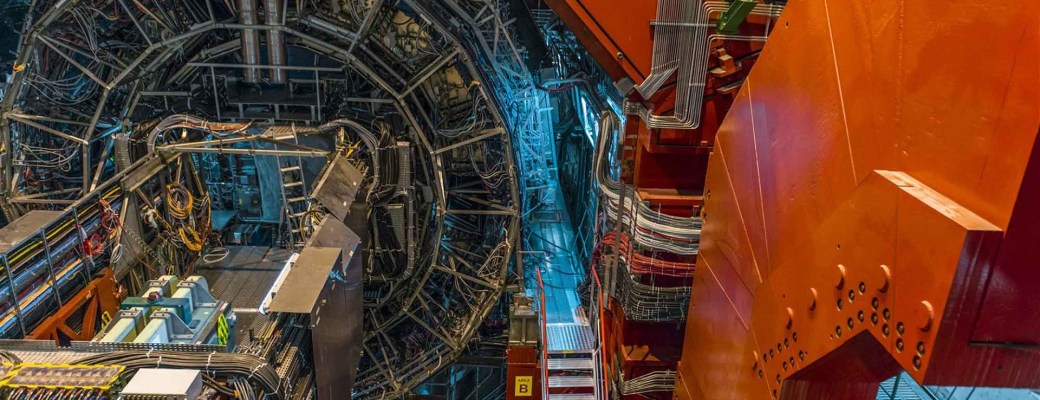

La Organización Europea para la Investigación Nuclear, comúnmente conocida como el CERN, ha logrado un hito en almacenamiento de datos. Sus servidores ya han superado el límite de los 200 petabytes en sus discos duros. Esta enorme cantidad de información procede, en su mayor parte, del LHC. El LHC, que a día de hoy sigue siendo el acelerador de partículas más potente del mundo, genera una suma de datos literalmente inasumible. No hay tanta capacidad de almacenamiento para guardar la información que el Gran Colisionador de Hadrones produce.

De ahí que los científicos del CERN solo puedan almacenar una pequeña parte de los datos generados. Son los más interesantes, la información más relevante de todo el caudal que arroja el LHC. A pesar de la exigente selección que realizan los investigadores del centro, actualmente se almacena un petabyte al día.

Esta cifra parece irrisoria teniendo en cuenta que la colisión de partículas en el LHC genera un petabyte cada segundo. Y es que en este breve lapso de tiempo tienen lugar 1.000 millones de choques de partículas.

A estos números se ha llegado a partir de un aumento drástico de la información en los últimos años. En 2016 se esperaba que solamente se almacenaran los datos correspondientes a cinco millones de segundos. Al final del ejercicio se comprobó que habían sido 7,5 millones de segundos los registrados. Es un aumento del 50% respecto a la previsión inicial y la tendencia de 2017 va en la misma línea.

Desde el CERN apuntan que a medida que el número de colisiones de partículas aumenta, los eventos son más complejos. Esto quiere decir que su reconstrucción y análisis es más difícil también, lo que redunda en un incremento de la necesidad de recursos de computación, tanto de procesamiento como de almacenamiento.

Aunque tampoco hay que olvidar las necesidades en cuanto a transferencia de datos. En este aspecto, el centro de datos del CERN está unido al Wigner Research Centre for Physics, en Hungría, por tres líneas de fibra. Cada una de ellas soporta velocidades de 100 Gbs.

Para que el CERN no viera limitados sus experimentos por culpa de una escasez de recursos informáticos, se llevó a cabo una actualización de los sistemas. Los responsables de LHC aprovecharon a hacerlo durante el llamado Long Shutdown 1, un parón en las operaciones debido a trabajos de mantenimiento.

Imágenes: CERN