Entender por qué sucede algo o por qué algo es como es. Es una de los cambios más importantes que la inteligencia artificial debe empezar a hacer para evolucionar más allá de identificar qué ocurre o qué aparece en una imagen. Los algoritmos actuales permiten identificar, reconocer e incluso predecir fenómenos o situaciones complejas. Pero falta introducir la causalidad. Saber qué ha hecho que algo pase, por qué sucede y/o qué implicaciones tendrá.

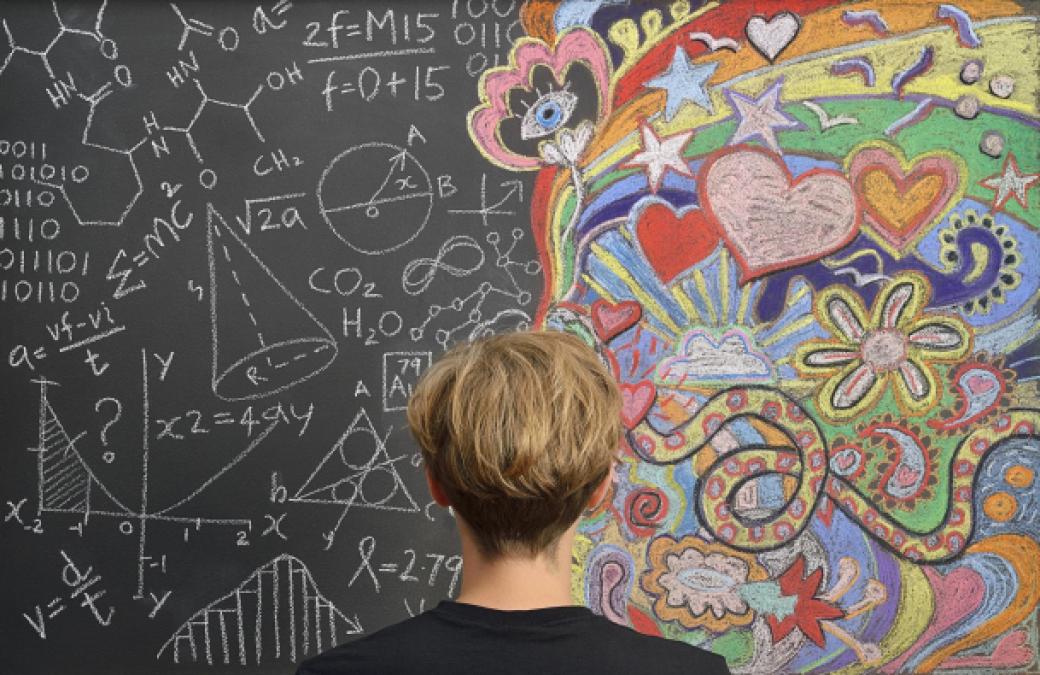

La inteligencia artificial que ya disfrutamos en nuestro día a día se traduce en diagnósticos médicos, recomendaciones de contenido audiovisual o de compras futuras, traducción en tiempo real, reconocimiento de texto, predicciones climáticas, identificación de personas u objetos en fotografías o vídeos… Pero para que la inteligencia sea realmente inteligente, valga el juego de palabras, muchos ahondan en que hace falta ir más allá en conceptos tan humanos como la abstracción o la causalidad.

La mente humana está capacitada para tomar decisiones. Y esas decisiones se basan en cómo procesamos la información que percibimos a través de los sentidos. Ahí, el racionamiento causal es importantísimo, ya que nos ayuda a comprender por qué sucede algo y, en consecuencia, qué ocurrirá después. Volviendo a la inteligencia artificial, los modelos actuales permiten saber qué ocurre. No por qué. Pero eso puede cambiar.

Inteligencia artificial y probabilidad estadística

Para la inteligencia artificial y el machine learning, las predicciones que éstos realizan se basan en grandes cantidades de datos numéricos que son procesados, organizados e interpretados. De ellos se extraen conclusiones como ocurre con los mapas meteorológicos. Si todos los mapas apuntan a que mañana lloverá y los datos estadísticos disponibles apuntan a que por esas fechas suele llover, es lógico pensar que así será.

Pero aunque a la inteligencia artificial, empleando machine learning y deep learning, se le da bien interpretar información y obtener conclusiones, no le es tan fácil explicar el por qué de esas conclusiones. Puede predecir un suceso o apuntar a un evento futuro pero no explicarlo. Y ahí radica la importancia de la causa y efecto, la causalidad, el pensamiento causal.

El objetivo de determinados investigadores es que la inteligencia artificial responda preguntas más complejas. Por ejemplo, que ayude a simplificar diagnósticos con el menor número de parámetros posibles o prevenir un problema de salud mucho antes de que el paciente note los primeros síntomas. En qué debemos fijarnos para predecir el mañana en lugar de ser capaces de prevenirlo mediante algoritmos.

Aprender a enseñar al aprendizaje artificial

Gracias al machine learning, una inteligencia artificial puede evolucionar, mejorar con respecto a sus primeros pasos. Esto hace que su valor, utilidad o prestaciones se amplíen a medida que la ponemos en práctica. Pero enseñarle a un algoritmo no es tan fácil. Hay qué saber qué enseñarle. Qué puede interpretar y qué no.

Un artículo de Qualcomm, empresa especializada en chips y microprocesadores, trata precisamente el enorme reto que supone cambiar la manera en que los investigadores le indican a una inteligencia artificial cómo debe aprender. Las redes neuronales artificiales reciben millones de datos que deben servir para reconocer a una persona, una animal o un objeto en una fotografía o a predecir sucesos o eventos a través de datos y representaciones gráficas. La manera en que esas representaciones son percibidas por la inteligencia artificial marcarán su evolución.

Un ejemplo práctico. ¿Cómo enseñar a una inteligencia artificial a entender que una serie de vehículos ha reducido su velocidad en carretera porque se aproxima una ambulancia y deben dejarla pasar? La ambulancia no forma parte de la información que está procesando la inteligencia artificial. Pero si logra incorporar las variables causales a su razonamiento, explicar ese suceso supone una gran evolución y puede servir para resolver problemas que, por ahora, se le escapan a los algoritmos.

La escalera de la causalidad

El tema no es nuevo. Si ya hace varios años que venimos hablando de la inteligencia artificial como algo que aparece en aplicaciones, dispositivos, páginas web, máquinas y toda clase de avances científicos y tecnológicos, en el lado de la investigación, los expertos en inteligencia artificial llevan más de una década intentando incorporar la causalidad en los modelos de machine learning.

El ingeniero computacional Judea Pearl, padre de las redes bayesianas, entre otros logros, teoriza en uno de sus libros sobre la escalera de la causalidad. Lo hace en su libro The Book of Why (2018), disponible en español desde 2020 bajo el título El libro del porqué. El subtítulo del libro es La nueva ciencia de la causa y el efecto, y explica las tres fases o peldaños que debe recorrer la inteligencia artificial para lograr a pensar como el ser humano. Al menos en lo que a parámetros causales se refiere.

Los tres peldaños son observar, hacer e imaginar. Asociación, intervención e imaginación. O explicado con analogías:

Asociación: Si veo X, ¿qué probabilidad hay de que vea Y?

Intervención: Si hago X, ¿con qué probabilidad veré Y?

Imaginación: ¿Qué pasaría con Y si hiciera X?

La inteligencia artificial que sabe pensar, no solo procesar

La inteligencia artificial se encuentra en el primer peldaño, en el de asociación. Es el mismo que comparten animales. Se asocian objetos, sucesos o imágenes de manera que la inteligencia artificial puede decir que mañana lloverá si los mapas de predicciones muestran una alta concentración de nubes en forma de borrasca. Pero no sabrá explicar el por qué sucede ese fenómeno.

El reto de la inteligencia artificial es llegar a los dos siguientes peldaños. En ellos, la realidad es interpretada y se deducen situaciones o eventos a partir de lo que vemos o hacemos con ella. Por un lado, conocer qué efecto tendrá una acción determinada. Y más allá, imaginar qué somos capaces de hacer con nuestras actuaciones. Bucear en la incertidumbre y obtener algo nuevo en lugar de limitarnos a las respuestas que ofrecen los datos disponibles.

Precisamente, esos dos peldaños son los que hacen que el ser humano sea capaz de planificar o de encontrar soluciones que no existen todavía a problemas de toda clase. Que la inteligencia artificial llegue a ese nivel es cuestión de tiempo y de saber qué información introducir en los modelos, cómo lograr que el algoritmo entienda el por qué de esa información y, en definitiva, sea capaz de ver más allá de los datos que le vengan dados.