La rivalidad entre gigantes de Internet por ofrecer la mejor inteligencia artificial del mercado va a traernos grandes beneficios para todos. El éxito de OpenAI con DALL-E y, especialmente, con ChatGPT, ha obligado a Google a ofrecer su propia IA con la mayor celeridad posible. Primero fue Bard, ahora renombrada a Gemini. Y tras un primer lanzamiento de Gemini 1.0, Google anuncia Gemini 1.5. Una versión mejorada de su modelo de IA.

En palabras de Demis Hassabis, CEO de Google DeepMind, “este es un momento emocionante para la IA. Los nuevos avances en el campo tienen el potencial de hacer que la IA sea más útil para miles de millones de personas en los próximos años”. Ejemplo de ello es que muchos ya integran herramientas como ChatGPT, Copilot o Gemini en su día a día para buscar en Internet, corregir textos, crearlos de la nada, programar o procesar datos.

Para empezar, preguntemos a Gemini qué es. Su respuesta: “Soy Gemini, la mejor manera de acceder directamente a la IA de Google. Me han entrenado con una gran cantidad de datos disponibles de forma pública, y puedo comunicarme y generar texto como lo haría un humano para responder una amplia variedad de preguntas”. A partir de aquí, ¿qué mejoras trae Gemini 1.5 con respecto a su versión anterior?

Mejor rendimiento y más eficiente

Como si de un automóvil o un teléfono móvil se tratara, las principales novedades de Gemini 1.5 respecto a la primera versión anunciada al público a finales de 2023 giran en torno a rendimiento y eficiencia. Es decir, que el modelo de IA de Google puede hacer más consumiendo los mismos recursos. Algo que parece muy abstracto o demasiado genérico, pero que permite comprender hacia dónde va la inteligencia artificial sin necesidad de comprender sus interioridades técnicas.

Una de las críticas que se le hacen a la inteligencia artificial es su hambre de recursos: memoria, capacidad de procesamiento y, en definitiva, electricidad. Un pilar del desarrollo de Gemini se centra, precisamente, en esto. Según sus responsables, Gemini 1.5 es más eficiente durante su entrenamiento y durante su funcionamiento de cara al público. Para ello, trabaja con una nueva arquitectura llamada Mixture-of-Experts (MoE). Que combina con la arquitectura Transformer.

Básicamente, la mezcla de expertos o mixture of experts es una técnica de aprendizaje automático para redes neuronales, las que hacen posible el aprendizaje de la inteligencia artificial. Para procesar más información de manera más eficiente, divide espacios problemáticos en regiones homogéneas. De manera que se ejecutan uno o dos modelos de expertos para cada problema a resolver en vez de ejecutarlos todos a la vez. Así, mientras que con la arquitectura Transformer se emplea una única red neuronal de grandes dimensiones, con MoE genera varias redes neuronales más pequeñas, pero eficientes para resolver tareas más sencillas. O menos exigentes.

La importancia del contexto en Gemini 1.5

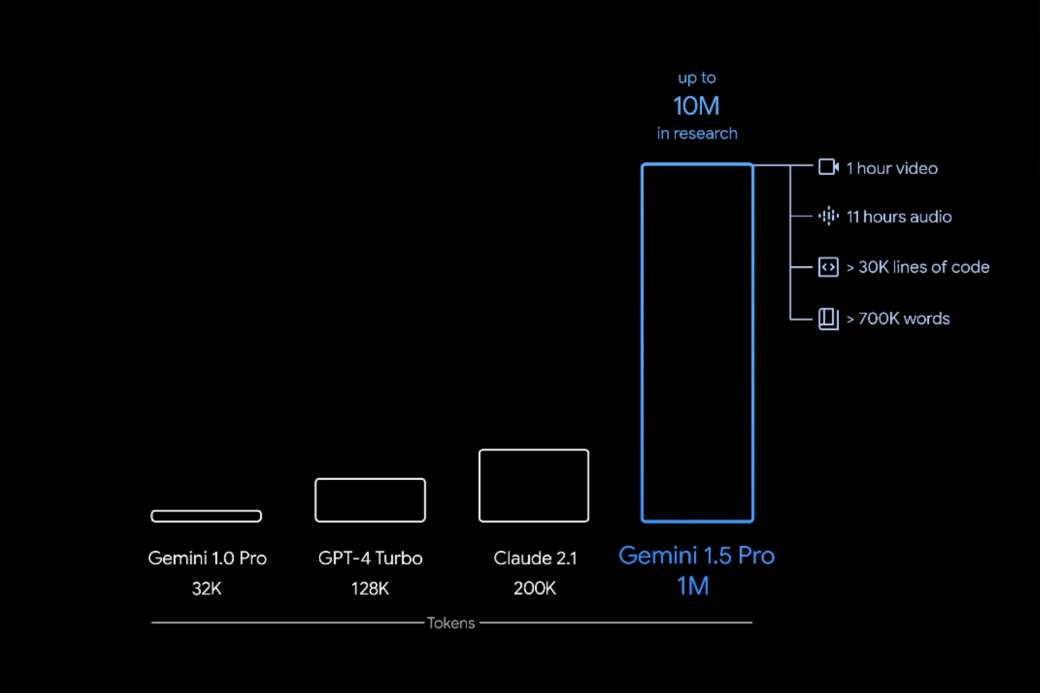

Para que veamos la diferencia de rendimiento y eficiencia con Gemini 1.0, Google compara distintas versiones de su modelo de inteligencia artificial. Gemini 1.5 Pro, la versión intermedia de su modelo de IA, equivale a Gemini 1.0 Ultra, la versión más potente hasta ahora. Usando como unidad de medida el token, Gemini 1.0 Pro llegaba a 32.000 tokens. GPT-4 Turbo alcanza los 128.000. Y Gemini 1.5 Pro es capaz de alcanzar 1 millón de tokens. Aunque parte de 128.000 para el público en general.

El token es, en el contexto de la inteligencia artificial, “una unidad fundamental para el desarrollo de modelos de IA. Permiten que los modelos de IA aprendan y procesen información de forma eficiente, faciliten la comparación y el análisis de diferentes modelos, y permitan la creación de modelos de IA más generalizables y robustos”. A más tokens, más capacidad de procesamiento. Más contexto para su aprendizaje. Y, por tanto, más posibilidades de ofrecer respuestas correctas a problemas complejos.

Gemini 1.0 partía de los 32.000 tokens iniciales. Hasta el millón de Gemini 1.5. Esto, en la práctica, implica que la IA de Google es capaz de procesar grandes cantidades de datos. En concreto, 1 hora de video, 11 horas de audio, 30.000 líneas de código y/o 700.000 palabras. Y, claro está, no hay un horizonte límite. En las pruebas realizadas a Gemini 1.5, se llegaron a alcanzar cifras de 10 millones de tokens. Por ejemplo, pusieron a prueba a Gemini 1.5 Pro para que procesara las 402 páginas de transcripción de la misión Apolo 11 a la luna. Y también le hicieron “ver” 44 minutos de una película de Buster Keaton para “analizar varios puntos y eventos de la trama e incluso razonar sobre pequeños detalles de la película que fácilmente podrían obviarse” por el ojo humano.

Cuando podrás acceder a Gemini 1.5

El anuncio de Gemini 1.5 dice que una “vista previa limitada de Gemini 1.5 está a disposición de desarrolladores y empresas” a través de Google AI Studio y Vertex AI. Se trata de herramientas basadas en la nube para crear y experimentar con los modelos de IA generativa de Google. Herramientas pensadas para desarrolladores, investigadores y empresas. En concreto, Gemini 1.5 Pro parte de un contexto de 128.000 tokens. Y en próximas semanas o meses, se lanzarán versiones con distintos precios que aumentarán ese contexto hasta el millón de tokens.

El público en general tendremos que esperar a poder disfrutar de Gemini 1.5 desde el enlace oficial de esta herramienta. Aunque si le preguntas a Gemini responde diciendo que utiliza la versión 1.5 de su IA, al preguntarle por la disponibilidad responde que todavía no está abierta a todo el mundo. Es decir, que por el momento, seguiremos usando Gemini 1.0 Pro de manera gratuita. Y Gemini 1.0 Ultra si te suscribes al servicio de pago de Gemini Advanced.