La inteligencia artificial está en todas partes y todo el mundo quiere estar en primera línea en la carrera por encabezar esta tecnología. Pese a que grandes como Google o Microsoft hacía años que trabajaban en ello en el ámbito científico, OpenAI decidió apostar por la visibilidad y darse a conocer al gran público con su IA GPT y la herramienta ChatGPT. Desde entonces, Google ha querido ganar terreno. Primero, con Bard. Y, ahora, quiere darlo todo en el campo de la inteligencia artificial con Gemini, su modelo de IA más ambicioso hasta la fecha.

La primera respuesta de Google a OpenAI fue Bard. Quería ser la alternativa a ChatGPT. Ahora, con Gemini, quieren ofrecer a todo el mundo un modelo de IA que haga sombra a GPT, el modelo de inteligencia artificial de OpenAI. El anuncio ha sido a cargo, nada más y nada menos, que de Sundar Pichai, CEO de Google y de su matriz Alphabet. Y de Demis Hassabis, CEO y cofundador de DeepMind, empresa adquirida hace años por Google y que fue una de las pioneras en el campo de la inteligencia artificial.

El anuncio es toda una declaración de intenciones por parte de Google. El titular dice “Presentamos Gemini: nuestro modelo de IA más grande y capaz”. Y, debajo un lema que todos los desarrolladores de inteligencia artificial vienen empleando: “Hacer que la IA sea más útil para todos”. Pero, ¿qué es exactamente Gemini? ¿Qué va a suponer para nosotros y qué quiere ofrecer Google con este modelo de IA?

La IA generativa más avanzada de Google

Cuando Microsoft acordó con OpenAI integrar su IA GPT en el buscador Bing, muy pronto se vio que el siguiente paso era añadir inteligencia artificial generativa a otros productos y servicios de Microsoft. Como Office (Word, Excel, Outlookt…), Windows (a través de Copilot) y un largo etcétera. Google quiere hacer lo propio con su catálogo de servicios y productos online. Si bien ya hace tiempo que emplea IA en algunas de sus apps online y móviles, su integración va a ser cada vez más visible de cara al usuario final.

Como dice en su anuncio de Gemini, Sundar Pichai recuerda que “millones de personas están usando IA generativa en nuestros productos”. Para “encontrar respuestas a preguntas complejas” y para tareas de creación y colaboración. Por su parte, empresas y desarrolladores utilizan los modelos de IA para crear aplicaciones basadas en IA generativa.

Gemini nace como un producto ligado a Google DeepMind, una de las muchas ramas de Google dedicadas a la inteligencia artificial. De ahí que su página oficial esté en el dominio de DeepMind. En ella se nos explica que el modelo de IA más ambicioso y potente de Google es multimodal, es decir, que puede trabajar tanto con texto como con imagen, video, audio y código.

Como es natural, Google compara Gemini con GPT-4 y afirma ser superior en tareas como dar respuestas a preguntas, razonamiento, cuestiones matemáticas y programación de código. Y también en sus capacidades para procesar imagen, video y audio. Y por procesar entendemos entender, descifrar, razonar o captar lo que está “viendo” u “oyendo”.

Tres versiones de Gemini a elegir

Como si de un teléfono móvil se tratara, o de un paquete ofimático, la IA de Google Gemini viene en tres versiones o tamaños. El motivo es que está pensada para satisfacer las necesidades de millones de personas con distintas necesidades. Hablamos de científicos, investigadores, analistas de datos, programadores y desarrolladores, profesionales de distintas ramas y, por qué no, cualquiera que tenga curiosidad por utilizar inteligencia artificial en su día a día.

Gemini Ultra es la versión más completa, pensada para las tareas más complejas. Por su parte, Gemini Pro es el modelo intermedio, a camino entre el gran público y el modelo profesional. Y, en tercer lugar, Gemini Nano, la versión “más eficiente” para tareas que deben correr en el propio dispositivo, como ordenadores o teléfonos móviles.

Entre las muchas tareas que puede realizar Gemini, como ocurre con cualquier IA generativa del mercado, en la página oficial de esta inteligencia artificial se muestran tres ejemplos. Tres actividades como escribir código a partir de cualquier petición en forma de texto, imagen, video o audio. Generar texto e imágenes, por separado o combinadas. Analizar y entender imágenes, como partituras musicales. Por ejemplo, explicando qué significa cada símbolo y notación o con qué instrumento se debe tocar.

Por lo demás, Demis Hassabis, CEO y cofundador de DeepMind, explica que “diseñamos Gemini para ser multimodal de forma nativa, preentrenada desde el principio en diferentes modalidades. Luego lo refinamos con datos multimodales adicionales para refinar aún más su eficacia. Esto ayuda a Gemini a entender y razonar sin problemas sobre todo tipo de entradas desde cero, mucho mejor que los modelos multimodales existentes, y sus capacidades son de última generación en casi todos los dominios”.

Inteligencia artificial fiable, escalable y eficiente

Ahora que ya sabemos lo que Gemini puede hacer, es importante saber qué supone esto en consumo de recursos. Las tres versiones de Gemini ya nos dan una pista de que Google quiere optimizar el uso de servidores en función de la complejidad de las tareas que se le exijan a su IA generativa.

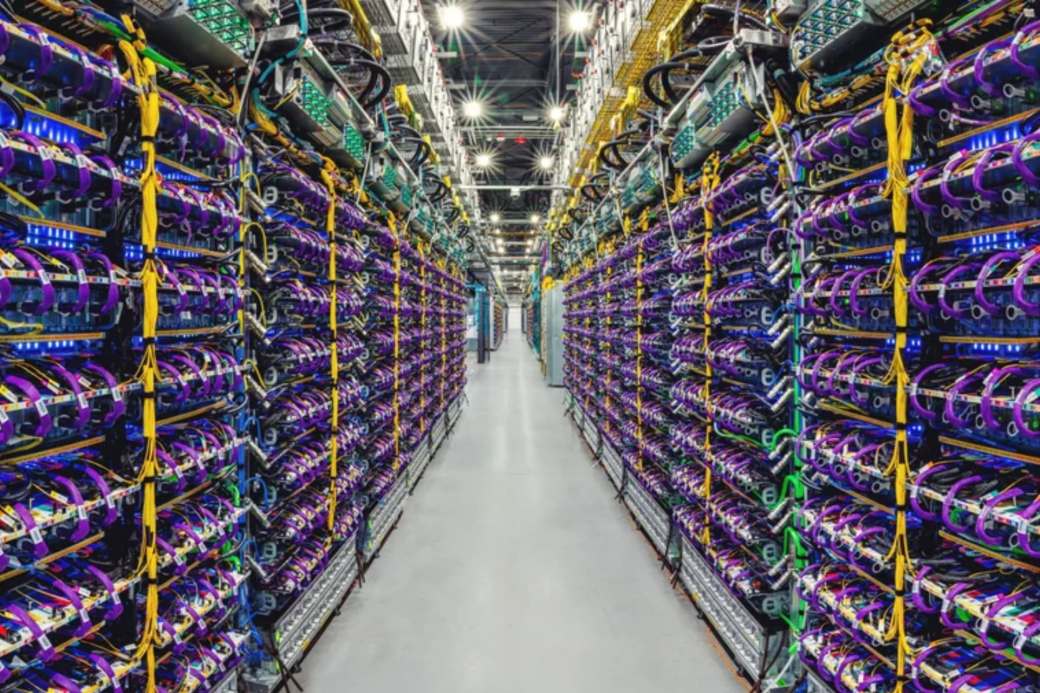

La eficiencia es imprescindible si tenemos en cuenta que determinadas tareas requieren el uso de supercomputadores a pleno rendimiento. Es más. Teniendo en cuenta que Google está integrado su modelo de IA en servicios tan populares como su buscador Google, YouTube, Gmail, Google Maps, Google Play y Android, esto implica millones de peticiones simultáneas.

Y para que todo funcione a pleno rendimiento y de la manera más óptima posible, Google ha puesto en marcha su propia máquina, Cloud TPU v5p. Un hipercomputador de inteligencia artificial que deberá satisfacer las peticiones hechas a Gemini en sus tres versiones. Y que, cómo no, se basa en su propia red de computación en la nube Google Cloud. En sus propias palabras, “una arquitectura innovadora de superordenador que emplea un sistema integrado de hardware optimizado para el rendimiento, software abierto, marcos de aprendizaje automático líderes y modelos de consumo flexibles.”.

Cómo puedo empezar a usar Gemini

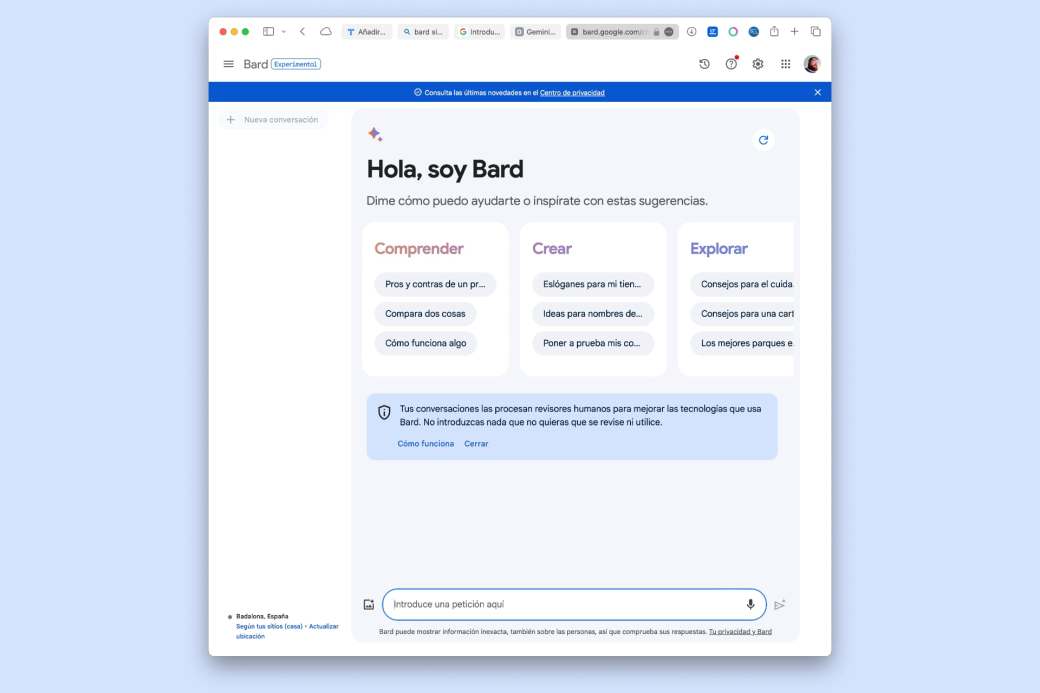

Gemini 1.0 está disponible en multitud de productos y servicios de Google. Es posible que ya estés usándo este modelo de IA sin darte cuenta. Para empezar, Bard integra Gemini Pro. Esta herramienta de consulta, todavía en fase experimental, ya permite probar hasta qué punto Gemini es capaz de resolver tus dudas, satisfacer tus necesidades o hacer lo que promete. Sin embargo, por el momento está limitado al idioma inglés, pero se puede usar en más de 170 países.

Segundo lugar en el que encontrarás Gemini: en los teléfonos Pixel. El smartphone Pixel 8 Pro es “el primer teléfono inteligente diseñado para ejecutar Gemini Nano, que está impulsando nuevas funciones como Summarize (Resumir) en la aplicación Recorder (Grabación) y desplegando en Smart Reply (Respuesta inteligente) en Gboard, comenzando con WhatsApp, con más aplicaciones de mensajería el próximo año”.

En los próximos meses, Gemini estará también en el buscador Google, en la publicidad de Google Ads, en Google Chrome o en Due AI. Además, los desarrolladores y cualquier empresa podrán usar Gemini Pro a través de su API con Google AI Studio o Google Cloud Vertex AI.

Por último, Gemini Ultra estará disponible en los próximos meses. Al ser la versión más completa de Gemini, Google quiere empezar a ofrecer esta versión de su modelo de IA a un grupo selecto de clientes y desarrolladores. Y, de paso, el año que viene verá la luz Bard Advanced. Será una versión más completa de esta herramienta basada en IA y que integrará Gemini Ultra.