En España y Latinoamérica, cuando hablamos de tecnología, solemos centrarnos en Estados Unidos. Sin embargo, en los últimos años, países como China o Corea del Sur han copado gran parte del mercado mundial de aplicaciones, servicios y dispositivos electrónicos. En el campo de la inteligencia artificial ocurre igual. Conocemos OpenAI, Meta, Google, Microsoft y Apple, empresas estadounidenses. Pero poco o nada sabemos de qué ocurre en otros países. Sin ir más lejos, el anuncio de DeepSeek, un modelo de inteligencia artificial chino, ha pillado a muchos por sorpresa. Un modelo que rivaliza con OpenAI y Meta.

Recientemente, el presidente de Estados Unidos y varias empresas anunciaron un proyecto multimillonario enfocado a potencia la industria de la inteligencia artificial de ese país. De nombre The Stargate Project, uno de los motivos para poner en marcha este proyecto es el avance de China en proyectos de IA. Sin ir más lejos, uno de ellos ha recibido la atención de todos los medios. Su nombre es DeepSeek y, tras un año de trabajo, ha logrado un modelo de IA que nada tiene que envidiar a modelos conocidos como GPT (de OpenAI), Llama (de Meta) o Claude (de Anthropic). Y es solo el principio.

El logro de DeepSeek se basa, entre otras cosas, en la eficacia de su proyecto. Su máximo responsable, Liang Wenfeng, solo ha necesitado dos años y 10.000 chips de Nvidia para crear un modelo de inteligencia artificial que el año pasado fue capaz de lidiar con los gigantes de Internet de China, ByteDance, Tencent, Baidu y Alibaba, entre otros. Y que ya era conocido también en Silicon Valley. Sin embargo, no ha sido hasta ahora, en los inicios de 2025, que DeepSeek se da a conocer entre el gran público.

Qué es DeepSeek

Empecemos por el principio. DeepSeek es un laboratorio de inteligencia artificial con sede en Hangzhou, China. Como curiosidad, esta ciudad en auge es también sede de grandes empresas tecnológicas como Alibaba, NetEase, Geely o HikVision. Este laboratorio fue fundado en mayo de 2023 por Liang Wenfeng. Y forma parte de una empresa más grande, High Flyer. Creada también por el propio Wenfeng. En un lejano 2016. High Flyer nace como hedge fund, es decir, un fondo de inversión, que llegará a contar con más de 15.000 millones de dólares. Y uno de sus proyectos más ambiciosos ha sido Fire Flyer, una subsidiaria enfocada en la investigación en deep learning. Una rama de la inteligencia artificial.

Así que a través de Fire Flyer, Liang Wenfeng creó superordenadores que, en un principio, debían procesar datos financieros. Pero en mayo de 2023 decidió cambiar de estrategia y crear DeepSeek, un proyecto para diseñar su propio modelo de inteligencia artificial. Tenía el dinero y tenía la infraestructura necesaria. Así que en noviembre de ese mismo año ya tenía disponible DeepSeek Coder, su primer modelo de IA. Lo puso a disposición de todo el mundo, gratis y con código abierto bajo licencia MIT.

Ese mismo mes publicaba su segundo modelo, DeepSeek LLM, con su propio chatbot o bot conversacional. Su propio ChatGPT, vamos. Y con una capacidad de procesamiento de 67.000 millones de parámetros. O 67B en inglés. Para hacernos una idea, GPT-1 de OpenAI (2018) era capaz de procesar 117 millones de parámetros. Y GPT-3 (2020), 175.000 millones de parámetros.

Por qué todos hablan de DeepSeek

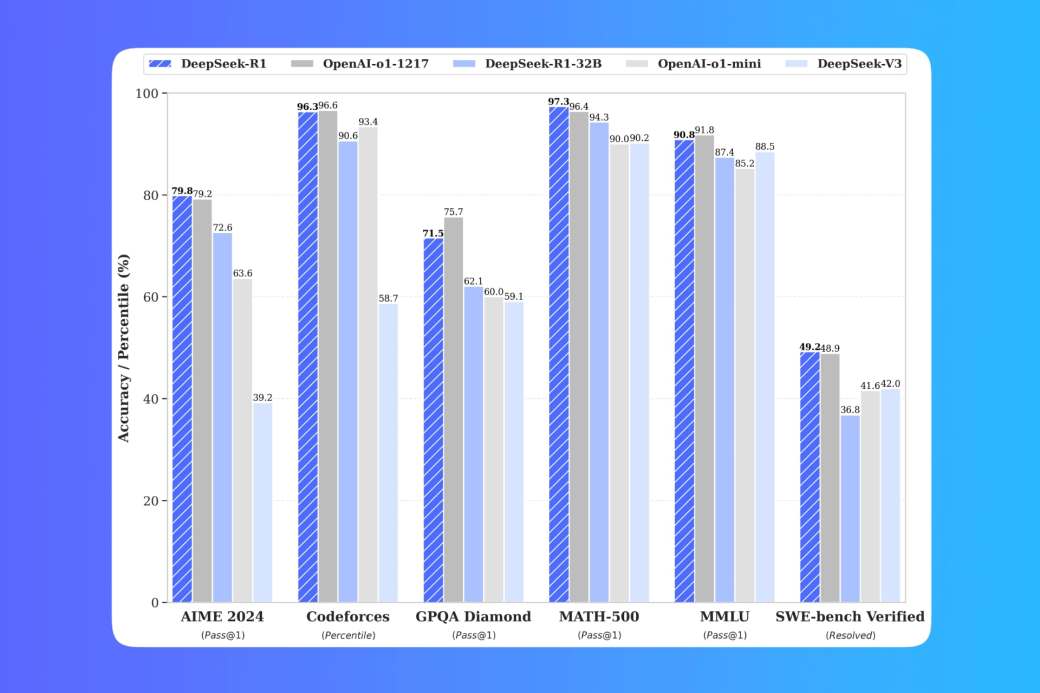

En mayo del año pasado, este peculiar laboratorio de IA anunciaba DeepSeek V2. Capaz de rivalizar con la competencia. Y que, además, destacaba por ser más barato. Más eficiente. En diciembre del mismo 2024, se anunciaba DeepSeek V3. Con 671.000 millones de parámetros. Y un entrenamiento de tan solo 55 días a un coste muy inferior a la competencia. En las pruebas realizadas, sus cifras superaban las de Llama 3.1 (de Meta), GPT-4o (de OpenAI) y Claude 3.5 Sonnet (de Anthropic). Con menos recursos disponibles, con un coste menor y en menos tiempo, DeepSeek había logrado un modelo de inteligencia artificial capaz de rivalizar con los grandes de Silicon Valley.

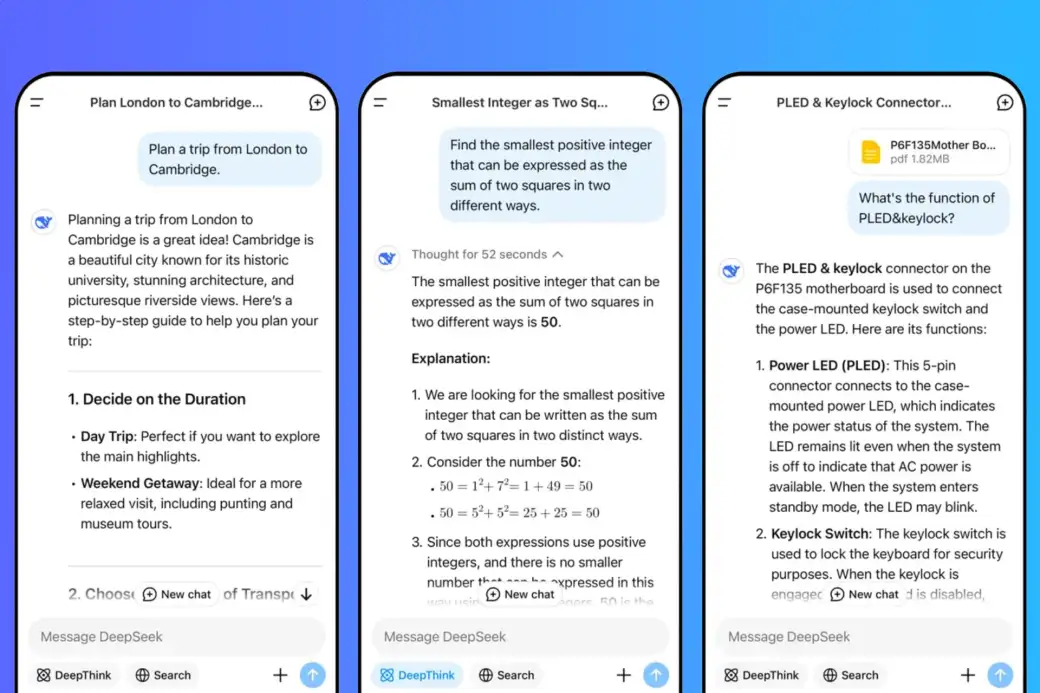

Y, en paralelo, también desarrolla un modelo llamado DeepSeek R1. Entrenado para la lógica, el razonamiento matemático y la resolución de problemas en tiempo real. Su capacidad de procesamiento es de 671.000 millones de parámetros. Y tiene una versión reducida, R1 Zero, de 37.000 millones de parámetros. Y, según las pruebas realizadas, está a la par con los modelos de IA de OpenAI y Meta, entre otros.

Otras peculiaridades de DeepSeek es que no depende económicamente de empresas chinas como Baidu, Alibaba o ByteDance. Más bien, al contrario. Es una digna rival. Y su modelo de IA también es una seria competencia para los modelos de estos gigantes de la internet china. Así que más pronto que tarde, DeepSeek tenía que dar la vuelta al mundo, como ha ocurrido recientemente.

Y, desde no hace mucho, se ha dado a conocer en Estados Unidos. Un mercado copado por sus propios asistentes de IA. Así, esta propuesta china ha decidido publicar su propio bot conversacional, su propio ChatGPT que puede instalarse gratis en iPhone y Android. En el momento de escribir este artículo, la app DeepSeek para iPhone es la más descargada. ChatGPT queda en un tercer lugar. Y en Google Play, es la app número 20 en descargas. Y subiendo puestos.

Las claves del éxito de DeepSeek

DeepSeek tiene todos los ingredientes para convertirse en uno de los principales contendientes en la industria de la inteligencia artificial a nivel mundial. Para empezar, no busca el beneficio económico. Se ofrece gratis, con código abierto para desarrolladores, su coste es menor que los modelos de IA de la competencia, como OpenAI, Google o Microsoft, que se ven obligados a ofrecer propuestas de pago para recuperar la inversión, cubrir los costes en infraestructura que implica el uso de la inteligencia artificial, y, finalmente, obtener beneficios.

Según una investigación de Epoch AI, DeepSeek V3 requiere una potencia de computación diez veces menor que Llama 3.1 de meta. Uno de los motivos es que, según explica Wired, “ha logrado un progreso significativo en Multi-head Latent Attention (MLA) y Mixture-of-Experts, dos diseños técnicos que hacen que los modelos DeepSeek sean más rentables al requerir menos recursos informáticos para entrenar”. En esa investigación se explica, largo y tendido, en qué consiste ambas aproximaciones técnicas. Para quienes quieran profundizar más.

Cómo empezar a usar la IA de DeepSeek

DeepSeek, que da nombre a la empresa que desarrolla este modelo de IA y a la IA en sí misma, está disponible en varias versiones. Para empezar, vía web, como ocurre con ChatGPT o Gemini. Solo tienes que darte de alta como usuario y empezar a interactuar con DeepSeek desde tu navegador web. Y como vimos antes, desde no hace mucho, DeepSeek está disponible en forma de asistente virtual para iPhone y Android. Se puede descargar e instalar en iOS y Android.

Para quienes quieren trabajar con esta inteligencia artificial y desarrollar sus propias apps y servicios, está disponible su API de pago y una plataforma de desarrollo. Y tiene su propio espacio en GitHub, donde explica cómo probar DeepSeek en modo local o desde servicios externos como Hugging Face.

Si te ha gustado este artículo y quieres recibir más contenido sobre innovación y tecnología directamente en tu correo, suscríbete a nuestra newsletter y mantente siempre actualizado. No somos de los que llenan tu bandeja, solo compartimos los lunes.