Aún no está claro cómo hay que tratar a la inteligencia artificial, sobre todo en el futuro, cuando la regulación legal de los robots sea uno de los pilares de la convivencia.

La ciencia ficción de tipo distópico está llena de historias en las que los robots se rebelan, toman el control, en definitiva se exceden de las funciones reservadas para ellos. La robótica no ha avanzado tanto como para que este argumento tenga sentido a corto plazo, pero a día de hoy ya se están poniendo las bases para la regulación legal de los robots, que influirá en cómo será en el futuro su relación con las personas dentro de la sociedad.

Cuando se habla de robots y de responsabilidad legal se tiende a pensar en la máquina de forma humanoide que podría disponer de libertad de acción. No hace falta llegar a esos extremos morales para que la regulación legal de los robots sea fuente de polémica. En la conferencia ‘We robot’ del pasado año en Stanford se concluyó que nuestro sistema legal está pobremente preparado. No, no hacía falta que esto lo corroboraran en Stanford, pero también arrojaron luz sobre otros aspectos notables.

En la conferencia sobre todo se plantearon dudas e ideas. Una de las más destacadas consistió en si un crimen puede ser cometido por un algoritmo y si en ese caso debería ser castigado. Dejando aparte las disquisiciones más abstractas, en los coches autónomos – una tecnología a punto de caramelo para comercializarse – se ponen de relieve los vacíos legales. ¿Quién tiene la responsabilidad de un accidente? El fabricante y el proveedor de servicios (datos, mapas, inteligencia artificial) podrían ser acusados de negligencia si alguno de sus sistemas fallara.

Se puede ir más allá. Teniendo todos los datos que tiene el proveedor de servicios, si detecta que uno de sus coches conduce a 90 km/h en una zona donde debería ir a 50km/h, ¿debería avisar el sistema robótico de la compañía al conductor?, ¿o debería comunicarlo a la policía? Y si no lo hace, ¿de quién es la culpa en el caso de que ocurra algo? No hay un marco legal establecido para este ámbito, como tampoco lo hay para los implantes robóticos. El contrato que se firma con el fabricante no difiere de las condiciones que se aceptan al comprar un iPad. No existen garantías para usos no autorizados. Estos términos de servicio podrían limitar la capacidad de una persona para tomar decisiones sobre sí misma.

El bloguero y autor de ciencia ficción Cory Doctorow apunta en The Guardian que en la regulación legal de los robots tendrían que colaborar varios grupos. En el caso de los coches autónomos deberían tener voz desde los fabricantes, las aseguradoras y los legisladores, hasta las organizaciones que defienden los derechos del consumidor y los colegios de ingenieros. También comenta que no se puede separar la legislación de este sector de la normativa que enmarca al software. No en vano los robots no dejan de estar constituidos por un software que controla una máquina.

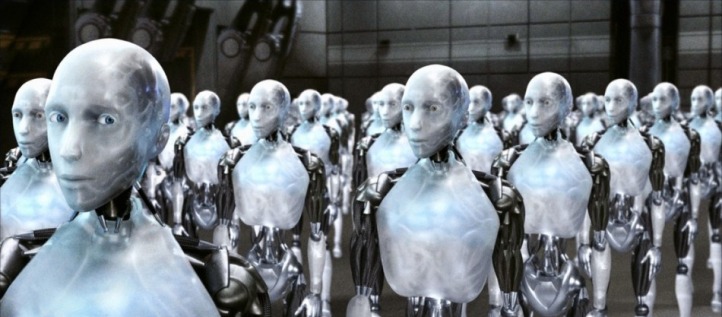

Además, el bloguero aporta una reflexión interesante acerca de cómo vemos el futuro de la robótica. La imagen más recurrente es la de robots humanoides que realizan tareas propias de los humanos. Sin embargo, parece más factible que sea un solo ordenador el que envíe instrucciones a muchos robots, en lugar de que cada uno tenga una total autonomía individual. Una circunstancia que se lleva al extremo en la película ‘Yo, robot’, inspirada las tres leyes de la robótica que planteó Isaac Asmiov. La sensatez y sencillez de estas normas las convierten en una guía para el futuro, aunque su previsión es tal que siguen ancladas en el terreno de la ciencia ficción. En este caso lo que se estaría previendo es la autonomía de la máquina para actuar con independencia de los seres humanos y también de su fabricante.

Los robots no son otra cosa que herramientas

Para despejarse la cabeza de elucubraciones futuristas vale la pena leer el ensayo publicado por dos profesores de la Universidad de Washington en St Louis, Neil M. Richards, experto en leyes, y William D. Smart, experto en ciencias de la computación, que aborda la cuestión desde su arista más pragmática. En él indican que la regulación de los robots debe partir de la experiencia que hemos acumulado legislando sobre el mundo digital y las tecnologías.

Resulta necesario estudiar en qué se ha fallado y cuáles han sido los aciertos para establecer un marco legal respaldado con información, buscando analogías entre las tecnologías de ahora y los robots que están por venir. Los profesores de la Universidad de Washington hacen hincapié en una idea que consideran esencial. Su concepción fundamental de los robots es la de herramientas, sofisticadas y complejas, pero cuya función básica no difiere de la de un martillo. Lo explican en este extracto del ensayo:

“Incluso cuando un robot en concreto no tiene forma de humano encontramos difícil no proyectar atributos humanos, como intenciones y motivaciones en éste. Incluso en los laboratorios de investigación las cámaras se describen como ‘ojos’, los robots se muestran ‘asustados’ de los obstáculos y necesitan ‘pensar’ sobre el siguiente paso. Esta proyección de atributos humanos es peligrosa cuando intentamos diseñar una legislación para los robots. Los robots son, y serán por muchos años, herramientas”.

Imagen: Richard Masoner / Cyclelicious